Sim, os switches Ultra PoE normalmente suportam a priorização de dados com recursos de Qualidade de Serviço (QoS), que são cruciais para gerenciar e otimizar o tráfego de rede, garantindo que os fluxos de dados críticos recebam a largura de banda necessária e a baixa latência de que necessitam. Em ambientes onde dispositivos alimentados por PoE (como câmeras IP, pontos de acesso Wi-Fi, telefones VoIP ou sensores de segurança) dependem de desempenho de rede estável e previsível, a QoS ajuda a priorizar determinados tipos de tráfego, melhorando a experiência geral do usuário e a confiabilidade da rede. .Aqui está uma descrição detalhada de como a QoS e a priorização de dados funcionam em switches Ultra PoE:

1. O que é QoS (Qualidade de Serviço)?

Qualidade de Serviço (QoS) é uma tecnologia de gerenciamento de rede que prioriza tipos específicos de tráfego em detrimento de outros para garantir desempenho ideal para aplicativos críticos. A QoS ajuda a controlar o fluxo de dados em uma rede, atribuindo níveis de prioridade a vários tipos de tráfego de dados, reduzindo atrasos, instabilidade e perda de pacotes para aplicativos de alta prioridade.

Por exemplo:

--- Aplicativos em tempo real, como voz sobre IP (VoIP) ou vigilância por vídeo (câmeras IP), precisam de baixa latência e largura de banda consistente.

--- As transferências de dados em massa (como downloads de arquivos ou backups) são menos sensíveis a atrasos e podem ter prioridade mais baixa.

--- Ultra Interruptores PoE pode usar QoS para garantir que o tráfego urgente, como vídeo em tempo real ou tráfego de voz, seja priorizado, garantindo o desempenho desses serviços mesmo quando a rede estiver congestionada.

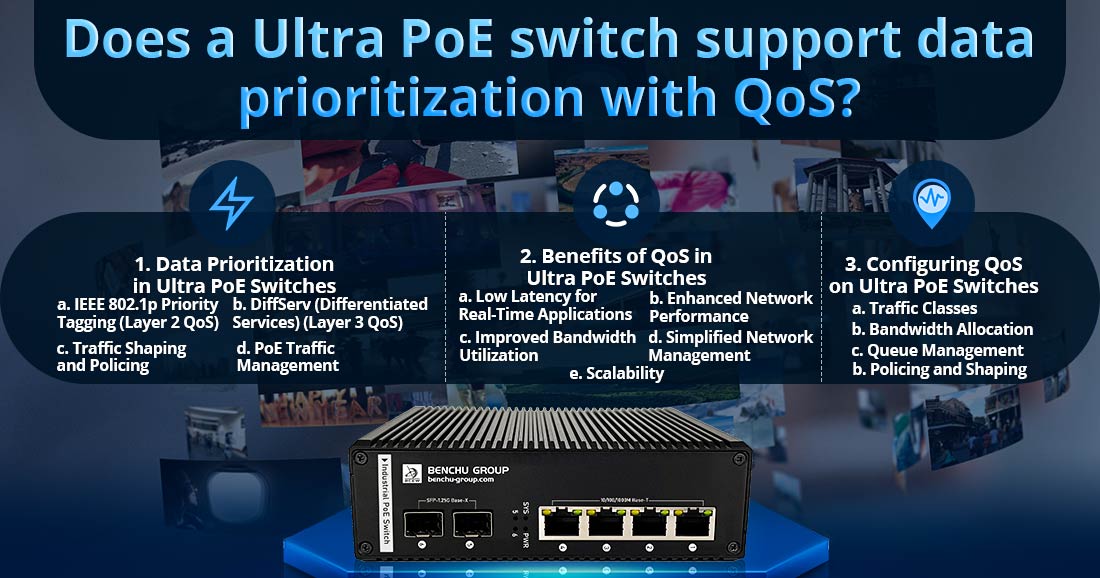

2. Priorização de dados em switches Ultra PoE

Nos switches Ultra PoE, a priorização de dados é obtida por meio de mecanismos de QoS, que atribuem níveis de prioridade a diferentes tipos de dados com base em regras predefinidas. Esses mecanismos normalmente usam vários métodos para classificar e priorizar o tráfego:

um. Marcação de prioridade IEEE 802.1p (QoS de camada 2)

--- 802.1p é um padrão IEEE que fornece um mecanismo para priorizar o tráfego de rede na camada 2 (camada de enlace de dados).

--- A marcação de prioridade 802.1p adiciona uma etiqueta de prioridade ao cabeçalho do quadro Ethernet, indicando o nível de prioridade do pacote. Isto permite que o switch atribua diferentes níveis de importância a diferentes tipos de tráfego, garantindo que o tráfego de alta prioridade (por exemplo, chamadas VoIP ou fluxos de vídeo) seja encaminhado com atraso mínimo.

--- 8 níveis de prioridade estão disponíveis, variando de 0 (prioridade mais baixa) a 7 (prioridade mais alta), permitindo um controle refinado sobre como o tráfego é tratado na rede.

b. DiffServ (serviços diferenciados) (QoS da camada 3)

--- DiffServ é um mecanismo de QoS usado na camada 3 (camada de rede), que fornece uma maneira escalável e flexível de gerenciar a priorização de tráfego.

--- DiffServ usa um valor DSCP (Differentiated Services Code Point) no cabeçalho IP para atribuir tráfego a diferentes classes para priorização. Isso é usado por roteadores e switches da Camada 3 para determinar como os pacotes devem ser tratados à medida que viajam pela rede.

--- O DiffServ permite políticas de QoS em toda a rede, garantindo que o tráfego crítico, como vídeo ou voz, seja tratado com maior prioridade do que o tráfego de dados normal, independentemente de onde esteja na rede.

c. Modelagem e Policiamento de Tráfego

--- Modelagem de tráfego é um método usado para controlar a taxa na qual os dados são enviados pela rede. Garante que o tráfego seja transmitido a uma taxa ideal, evitando congestionamentos e garantindo que o tráfego de alta prioridade não seja atrasado por tráfego de prioridade mais baixa.

--- O policiamento de tráfego é outro método usado para gerenciar o tráfego de rede. Envolve monitorar o fluxo de tráfego e aplicar políticas, como limitação de taxa ou descarte de tráfego excessivo. Isto ajuda a garantir que os recursos da rede sejam alocados de acordo com a prioridade, evitando sobrecarga da rede.

d. Gerenciamento de tráfego PoE

--- Em switches Ultra PoE, o QoS também pode priorizar o tráfego PoE (por exemplo, câmeras IP, telefones VoIP, pontos de acesso Wi-Fi) junto com o tráfego regular de dados. Por exemplo, se uma câmera IP envia dados de vídeo que exigem baixa latência, o switch pode priorizar esse fluxo de vídeo em relação a um tráfego menos sensível ao tempo, garantindo que o desempenho da câmera não seja prejudicado pelo congestionamento da rede.

--- Alguns switches Ultra PoE suportam priorização automática de PoE, o que permite que o switch priorize o fornecimento de energia para dispositivos críticos em detrimento de outros dispositivos não essenciais, garantindo um fornecimento de energia consistente mesmo sob carga.

3. Benefícios de QoS em switches Ultra PoE

A QoS ajuda a otimizar o desempenho da rede de diversas maneiras, principalmente em ambientes onde vários dispositivos compartilham a mesma rede e alguns tipos de tráfego exigem tratamento especial. Aqui estão os principais benefícios:

um. Baixa latência para aplicações em tempo real

--- Para aplicações como VoIP, vigilância por vídeo e transmissão ao vivo, a baixa latência é essencial para garantir comunicação e serviço de alta qualidade. A QoS prioriza o tráfego em tempo real sobre o tráfego não crítico, reduzindo atrasos e evitando a perda de pacotes que poderia resultar em chamadas ou feeds de vídeo de baixa qualidade.

b. Desempenho de rede aprimorado

--- Ao dar prioridade aos dados críticos, os switches Ultra PoE com recursos de QoS podem lidar com o congestionamento da rede de forma mais eficaz. Quando vários tipos de tráfego competem pela largura de banda, a QoS garante que o tráfego de alta prioridade seja encaminhado primeiro, enquanto o tráfego de prioridade mais baixa será atrasado ou descartado, se necessário.

--- Videoconferência/Vigilância: Sistemas de videovigilância, como câmeras IP, exigem largura de banda estável e consistente. Com QoS, esses fluxos podem ser priorizados, garantindo feeds de vídeo nítidos e sem interrupções.

--- VoIP: As chamadas VoIP são altamente sensíveis à latência e instabilidade da rede. A QoS garante que os pacotes de voz sejam priorizados, evitando quedas de chamadas, atrasos ou áudio de baixa qualidade.

c. Utilização aprimorada de largura de banda

--- Com mecanismos de QoS, um switch Ultra PoE pode ajudar a distribuir a largura de banda disponível de forma mais eficiente, garantindo que aplicativos críticos recebam os recursos necessários, enquanto aplicativos menos sensíveis ao tempo não monopolizam a largura de banda disponível.

--- Em uma rede com tráfego misto (por exemplo, streaming de vídeo, transferências de arquivos, navegação na web), o QoS garante que o tráfego crítico, como fluxos de vídeo ou chamadas de voz, não seja prejudicado por outras atividades menos importantes, como downloads de arquivos grandes.

d. Gerenciamento de rede simplificado

--- QoS simplifica o gerenciamento de rede, permitindo que os administradores de rede definam políticas claras para priorização de tráfego e alocação de largura de banda. Isso ajuda a garantir que dispositivos críticos, como câmeras IP e telefones VoIP, mantenham o desempenho ideal mesmo durante períodos de alta demanda de rede.

--- Gerenciamento centralizado: Em redes empresariais ou industriais, os switches Ultra PoE geralmente vêm com ferramentas de gerenciamento centralizado que permitem aos administradores configurar políticas de QoS em vários switches. Isto simplifica o processo de garantir que toda a rede esteja operando com as regras de priorização corretas.

e. Escalabilidade

--- A QoS pode ser implementada de maneira escalonável para lidar com redes em crescimento. À medida que novos dispositivos são adicionados, a rede pode continuar a operar de forma eficiente, com impacto mínimo no tráfego de alta prioridade. Isto é especialmente útil em ambientes onde novos dispositivos (por exemplo, câmeras IP, sensores, pontos de acesso) são continuamente adicionados à rede.

4. Configurando QoS em switches Ultra PoE

Para configurar QoS em um switch Ultra PoE, os administradores normalmente definem os seguintes parâmetros:

--- Classes de tráfego: Definir classes de tráfego com base no tipo de aplicação (por exemplo, VoIP, streaming de vídeo, dados gerais) e atribuir níveis de prioridade (usando 802.1p ou DiffServ).

--- Alocação de largura de banda: Definir limites máximos e mínimos de largura de banda para diferentes classes de tráfego para evitar congestionamentos.

--- Gerenciamento de filas: Configurar filas de tráfego e definir a ordem em que o tráfego deve ser transmitido. O tráfego de prioridade mais alta normalmente é enviado de filas de prioridade mais alta.

--- Policiamento e Modelagem: Definir regras para modelagem de tráfego (regular o fluxo de tráfego para evitar congestionamentos) e policiamento (monitorar e fazer cumprir limites de tráfego).

Conclusão

Sim, Ultra Interruptores PoE suportam a priorização de dados com QoS, o que oferece vários benefícios para garantir a operação suave de aplicativos urgentes, como VoIP, vigilância IP e transmissão ao vivo. Ao usar mecanismos como marcação de prioridade 802.1p, DiffServ, modelagem de tráfego e policiamento de tráfego, os switches Ultra PoE podem priorizar o tráfego crítico, reduzir a latência, melhorar o desempenho da rede e garantir uma utilização consistente da largura de banda. Isto torna o QoS um recurso essencial em ambientes onde são necessários alta confiabilidade de rede e desempenho ideal, especialmente para aplicações que dependem tanto de tráfego de dados quanto de energia PoE.